神经假体使用大脑活动来解码语音

来自HSE大学和莫斯科国立医学和牙科大学的研究人员开发了一种机器学习模型,可以根据受试者用一小组微创电极记录的神经活动来预测受试者即将说出的单词。他们的论文“来自一小组空间隔离的微创颅内脑电图电极的语音解码,具有紧凑且可解释的神经网络”,已发表在《神经工程杂志》上。

全世界有数百万人受到言语障碍的影响,限制了他们的沟通能力。言语丧失的原因可能多种多样,包括中风和某些先天性疾病。

如今,技术可用于恢复此类患者的沟通功能,包括“无声语音”界面,该界面通过跟踪发音肌肉的运动来识别语音,因为人们在不发出声音的情况下说话。然而,这种设备可以帮助一些患者,但不能帮助其他人,例如面肌麻痹的人。

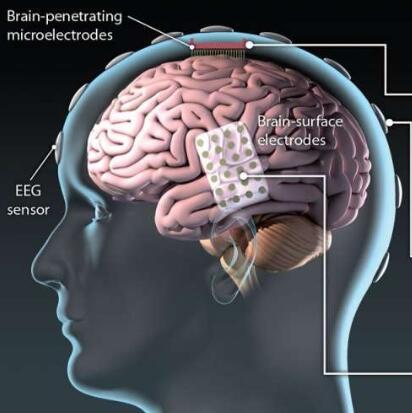

言语神经假体 - 能够根据大脑活动解码语音的脑机接口 - 可以为恢复与此类患者的通信提供可访问且可靠的解决方案。

与个人计算机不同,具有脑机接口(BCI)的设备直接由大脑控制,无需键盘或麦克风。

在言语假肢中广泛使用BCI的一个主要障碍是,这项技术需要高度侵入性的手术才能将电极植入脑组织中。

最准确的语音识别是通过带有覆盖大面积皮质表面的电极的神经假体实现的。然而,这些用于读取大脑活动的解决方案不适合长期使用,并且对患者存在重大风险。

HSE生物电界面中心和莫斯科国立医学和牙科大学的研究人员研究了创建功能性神经假体的可能性,该假体能够通过从植入有限皮质区域的一小组电极中读取大脑活动,以可接受的精度解码语音。作者建议,在未来,这种微创手术甚至可以在局部麻醉下进行。

在本研究中,研究人员收集了两名癫痫患者的数据,他们已经植入了颅内电极,以便进行术前绘图以定位癫痫发作区域。

第一位患者双侧植入总共五个sEEG轴,每个轴有六个触点,第二个患者植入九个皮质电图(ECoG)条,每个条带有八个触点。与ECoG不同,sEEG电极可以通过颅骨上的钻孔植入而无需进行完整的开颅手术。在这项研究中,仅使用一名患者单个sEEG轴的六个触点和另一名患者一个ECoG条带的八个触点来解码神经活动。

受试者被要求大声朗读六句话,每句话以随机顺序呈现30至60次。句子的结构各不相同,单个句子中的大多数单词都以相同的字母开头。这些句子总共包含26个不同的单词。当受试者阅读时,电极记录了他们的大脑活动。

然后将这些数据与音频信号对齐,形成27个类,包括26个单词和一个静音类。生成的训练数据集(包含实验前 40 分钟内记录的信号)被馈送到具有基于神经网络的架构的机器学习模型中。神经网络的学习任务是根据其话语之前的神经活动数据预测下一个说出的单词(类)。

在设计神经网络的架构时,研究人员希望使其简单、紧凑且易于解释。他们提出了一个两阶段架构,首先从记录的大脑活动数据中提取内部语音表示,产生log-mel频谱系数,然后预测一个特定的类别,即一个单词或沉默。

经过训练,神经网络在第一位患者中仅使用单个 sEEG 电极记录的六个通道数据实现了 55% 的准确率,在第二名患者中仅使用单个 ECoG 条记录的八个通道数据实现了 70% 的准确率。这种准确性与其他研究中证明的准确性相当,这些研究使用需要在整个皮质表面上植入电极的装置。

由此产生的可解释模型可以用神经生理学术语解释哪些神经信息对预测即将说出的单词贡献最大。研究人员检查了来自不同神经元群体的信号,以确定其中哪些对下游任务至关重要。他们的发现与语音映射结果一致,表明该模型使用神经信号至关重要,因此可用于解码想象的语音。

此解决方案的另一个优点是不需要手动特征工程。该模型已经学会了直接从大脑活动数据中提取语音表示。结果的可解释性还表明,网络解码来自大脑的信号,而不是来自任何伴随活动的信号,例如来自关节肌的电信号或由于麦克风效应而产生的电信号。

研究人员强调,预测始终基于话语之前的神经活动数据。他们认为,这确保了决策规则没有使用听觉皮层对已经说出的语音的反应。

“使用这种接口对患者来说风险最小。如果一切顺利,就有可能从在局部麻醉的门诊环境中植入的少量微创电极记录的神经活动中解码想象的语音,“该研究的主要作者,HSE认知神经科学研究所生物电界面中心主任Alexey Ossadtchi说。

免责声明:本文由用户上传,与本网站立场无关。财经信息仅供读者参考,并不构成投资建议。投资者据此操作,风险自担。 如有侵权请联系删除!

-

【首都师范大学是211吗】一、“首都师范大学是211吗”是许多考生和家长在选择大学时经常提出的问题。实际上,...浏览全文>>

-

【首都师范大学科德学院自考和统招毕业证不一样吗有什么不一样的】在选择继续教育方式时,很多学生都会关注“...浏览全文>>

-

【首都师范大学科德学院自考本科国家承认学历吗】一、“首都师范大学科德学院自考本科国家承认学历吗”是许多...浏览全文>>

-

【首都师范大学科德学院怎么样首都师范大学科德学院介绍】首都师范大学科德学院是一所位于北京市的全日制本科...浏览全文>>

-

【第一次电影剧情】《第一次》是一部由美国导演理查德·林克莱特(Richard Linklater)执导的电影,于2004年...浏览全文>>

-

【首都师范大学科德学院学费一年多少钱】首都师范大学科德学院是一所经教育部批准设立的全日制本科独立学院,...浏览全文>>

-

【第一次点外卖的流程】对于第一次尝试点外卖的人来说,整个过程可能会有些陌生。不过,只要按照步骤来,就能...浏览全文>>

-

【首都师范大学科德学院学费为什么要这么贵】首都师范大学科德学院作为一所独立学院,近年来在学费方面引发了...浏览全文>>

-

【第一次登泰山的忌讳】泰山,作为五岳之首,不仅是中国文化的重要象征,也是无数人心中的朝圣之地。对于第一...浏览全文>>

-

【首都师范大学科德学院位于哪个城市】首都师范大学科德学院是一所独立学院,隶属于首都师范大学。对于许多学...浏览全文>>